Ce qu’il faut retenir : bien que ChatGPT révolutionne la synthèse médicale et l’aide administrative, il reste un outil généraliste sujet aux « hallucinations » factuelles. La véritable avancée réside dans l’utilisation d’IA spécialisées qui, en automatisant le traitement des données, redonnent du temps au médecin pour l’examen clinique et la relation humaine, irremplaçables et non programmables.

Confier son diagnostic à une machine relève-t-il du génie ou de l’inconscience alors que le débat sur ChatGPT santé avantages inconvénients divise radicalement la communauté médicale ? Loin des discours marketing, nous avons disséqué les capacités réelles de cet outil pour comprendre s’il s’agit d’un assistant surdoué ou d’un danger public sujet aux hallucinations. Attendez-vous à être surpris par l’ampleur des risques cachés derrière la promesse d’une médecine 2.0 enfin accessible à tous.

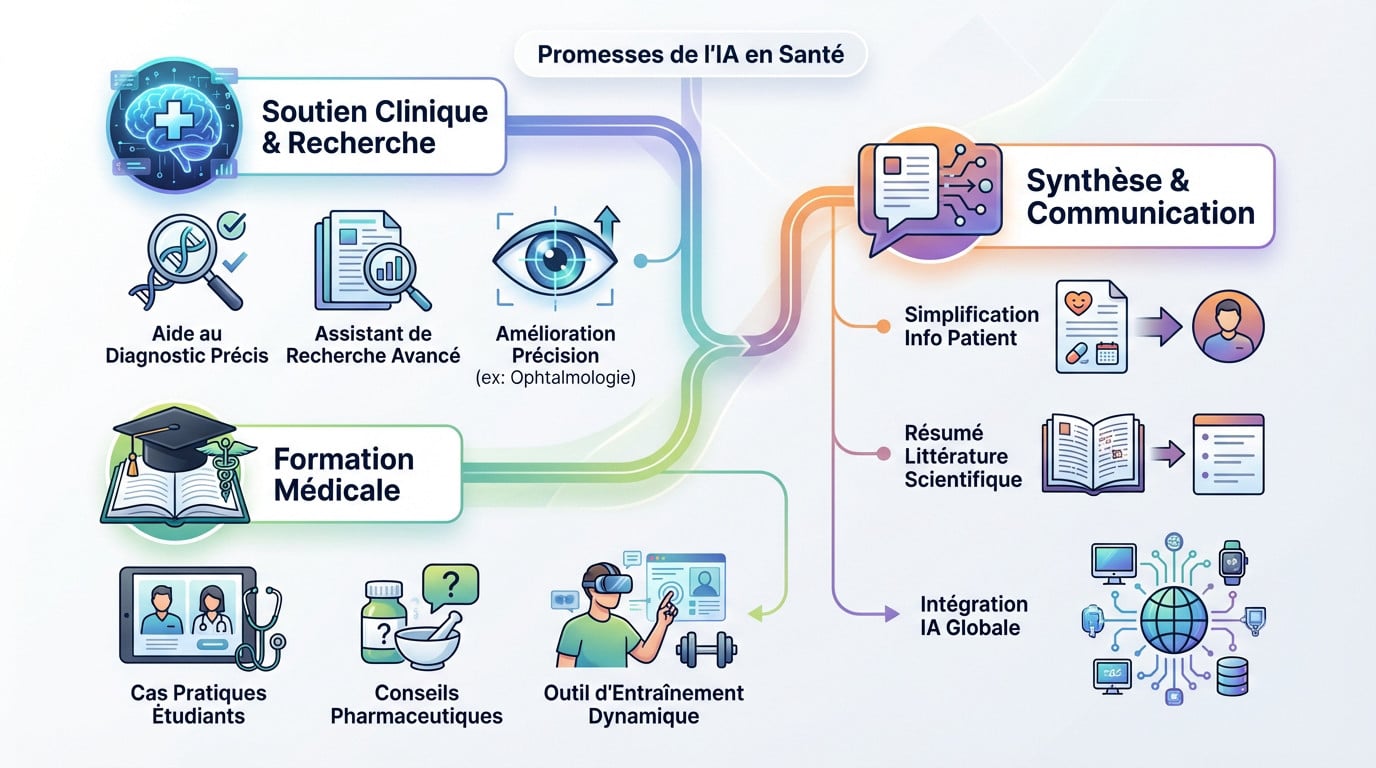

ChatGPT en santé, la promesse d’un assistant surdoué

Le milieu médical est en ébullition et ce n’est pas pour rien. Le lancement de chatgpt santé avantages inconvénients est analysé par des experts qui y voient bien plus qu’un simple gadget technologique. C’est un potentiel bras droit pour les médecins surchargés et une bouée de sauvetage pour les patients parfois perdus dans le jargon. On parle ici d’un outil capable de digérer des montagnes de données pour nous mâcher le travail, tout en gardant une approche humaine.

Un appui précieux pour la décision clinique et la recherche

Les experts voient un potentiel énorme pour le soutien à la décision clinique au quotidien. L’IA analyse les cas et offre des perspectives uniques pour affiner les diagnostics médicaux. C’est comme avoir un second avis instantané disponible en permanence.

Côté recherche, c’est un véritable accélérateur de particules pour les scientifiques. Il aide à formuler des hypothèses solides, suggère des plans d’analyse pertinents et rédige même des propositions. Bref, il traite des données complexes pour faire avancer la science.

Des études récentes ont d’ailleurs confirmé une amélioration notable de la précision diagnostique. C’est particulièrement flagrant en ophtalmologie, où la machine apprend de ses cas précédents pour viser juste.

Une nouvelle ressource pour la formation médicale

L’efficacité de ChatGPT dans l’éducation médicale est assez bluffante selon les premiers retours. Il génère des cas pratiques pour tester les étudiants et pige des concepts ardus comme en radio-oncologie. C’est un tuteur disponible nuit et jour.

Il fournit aussi des conseils pharmaceutiques clairs et explique les interactions médicamenteuses sans sourciller. C’est un atout majeur pour l’information des patients qui n’ont pas toujours accès immédiat à un pharmacien.

Son aptitude à apprendre de ses propres erreurs en fait un outil d’entraînement dynamique. Les futurs pros de santé peuvent ainsi s’exercer et progresser rapidement.

La synthèse de l’information, un atout pour la communication

Vous savez ce qui est souvent difficile ? Expliquer le jargon médical simplement. ChatGPT résume des informations complexes dans un langage simple que tout le monde comprend. C’est un avantage décisif pour communiquer des diagnostics ou des traitements aux patients et à leurs familles.

Cette capacité de synthèse est aussi une bénédiction pour la recherche académique. Elle permet de résumer rapidement de grandes quantités de littérature scientifique sans y passer des semaines entières.

Cette technologie s’inscrit dans une vague plus large d’intelligence artificielle qui transforme de nombreux secteurs aujourd’hui.

Le revers de la médaille, les limites criantes de l’IA

Mais derrière ce tableau prometteur, les experts tirent la sonnette d’alarme sur des failles bien réelles qui empêchent, pour l’instant, de lui faire une confiance aveugle.

Le spectre des « hallucinations » et des erreurs factuelles

Vous connaissez le concept d’hallucination IA ? C’est le piège absolu car le système génère une réponse qui semble parfaitement logique et structurée, mais qui est factuellement fausse. C’est le danger numéro un pour votre sécurité médicale.

Prenez des domaines pointus comme la gynécologie ou la curiethérapie. L’outil montre vite ses limites et invente parfois des protocoles inexistants, menant à des informations inexactes ou incomplètes. Les résultats deviennent alors incomplets ou dangereux.

Soyons clairs, aucun algorithme ne remplace une source médicale validée. Faire confiance aveuglément à la machine est une erreur stratégique.

Une boîte noire aux connaissances datées

Le manque de transparence est un vrai souci. On ignore totalement d’où proviennent les sources d’information utilisées pour construire les réponses, ce qui pose un problème de traçabilité. Cette absence de traçabilité rend toute vérification impossible.

Pire encore, la base de connaissances s’arrête souvent en 2021 pour GPT-3. Vous passez donc à côté des dernières avancées médicales, car il n’a pas accès aux recherches récentes. C’est comme consulter un manuel périmé.

C’est le défaut structurel de ces modèles de langage. Ils sont programmés pour créer des phrases probables, pas pour dire la vérité. La nuance est gigantesque.

La fiabilité en jeu : un tableau pour y voir clair

L’inconsistance des réponses est effrayante. Changez un mot dans votre question, et le diagnostic change du tout au tout, devenant parfois trompeur. Cette instabilité rend l’outil imprévisible pour un usage sérieux.

Rappelez-vous que l’IA ne prend aucune responsabilité sur ses écrits. En cas de pépin de santé, vous êtes seul face aux conséquences. C’est impensable pour le soin patient.

Pour bien saisir l’enjeu, regardons les faits en face. Analyser le duo chatgpt santé avantages inconvénients demande du recul. Voici un résumé brutal des promesses technologiques face aux risques concrets qui pèsent sur l’utilisateur actuel.

| Fonctionnalité | La Promesse (Avantage théorique) | La Réalité (Inconvénient et Risque) |

|---|---|---|

| Aide au diagnostic | Suggestions rapides basées sur des millions de données | Risque d’hallucinations, absence de contexte clinique, responsabilité nulle. |

| Information patient | Simplification de termes médicaux complexes, disponible 24/7 | Informations potentiellement fausses, datées ou biaisées. |

| Assistance à la recherche | Synthèse rapide de la littérature, génération d’hypothèses | Sources inconnues, risque de plagiat involontaire, biais dans les données. |

L’IA n’est pas un médecin, le facteur humain irremplaçable

Au-delà des erreurs techniques, le plus grand fossé entre l’IA et la médecine réside dans ce qui ne se programme pas : le contact humain et le raisonnement clinique. Si l’on analyse pour chatgpt santé avantages inconvénients, ce manque d’humanité pèse très lourd dans la balance.

L’absence d’examen clinique, un angle mort total

Soyons lucides : l’IA est physiquement absente de la consultation. Elle ne peut ni ausculter un cœur, ni palper un abdomen, ni observer la peau d’un patient. Cette incapacité radicale à réaliser un examen physique la rend aveugle aux réalités corporelles.

Sans ce contact direct, toute suggestion diagnostique n’est qu’une spéculation statistique hasardeuse. L’outil fonctionne littéralement à l’aveugle, privé de ces informations sensorielles brutes qui font toute la différence. C’est jouer aux devinettes avec votre santé.

De plus, l’IA rate complètement le contexte non-verbal d’une consultation. Elle ne voit pas la grimace de douleur ou l’anxiété dans le regard.

Le mirage du raisonnement clinique

Il ne faut pas confondre calcul probabiliste et véritable pensée médicale. L’IA prédit simplement le mot suivant le plus logique, elle ne réfléchit pas. Ce n’est pas du raisonnement clinique humain, c’est du mimétisme textuel avancé.

Un médecin, à l’inverse, fusionne son intuition, son expérience et l’historique unique du malade. Il procède par hypothèses successives, s’adapte et pivote selon les réactions. C’est une gymnastique intellectuelle complexe qu’aucun algorithme ne maîtrise encore.

L’IA peut analyser des millions de cas, mais elle ne peut pas tenir la main d’un patient ou comprendre la peur dans sa voix. C’est là que la médecine commence.

Confidentialité et sécurité, le talon d’Achille

Voici un problème qui devrait vous inquiéter : la confidentialité des données de santé. Les versions grand public de ChatGPT ne respectent ni le RGPD ni les normes HIPAA. C’est une faille de sécurité béante.

Chaque symptôme que vous tapez nourrit la machine et peut servir à son entraînement futur. Le risque de fuite ou d’exploitation commerciale de vos secrets médicaux est bien réel, et franchement effrayant.

Honnêtement, confier ses données de santé à un tel système est, pour l’instant, une prise de risque inconsidérée.

Vers des IA spécialisées, la réponse aux dérives

La distinction entre l’IA grand public et les outils dédiés

Quand on pèse le dossier chatgpt santé avantages inconvénients, on réalise vite que les critiques visent surtout le modèle grand public. Heureusement, des plateformes spécialisées émergent enfin, conçues dès le départ pour coller aux exigences vitales et complexes du secteur médical.

Ces outils ne sont pas de simples chatbots ; ils intègrent des versions « Santé » ou des solutions certifiées avec des cadres de sécurité et de confidentialité drastiquement renforcés pour protéger les patients.

Prenez l’exemple d’outils comme Abridge. Ils sont entraînés spécifiquement pour analyser et structurer la documentation médicale, montrant clairement la voie à suivre pour une adoption réussie et sans risque.

Quand l’IA collabore avec les médecins, pas contre eux

Il faut sortir de la peur binaire. Le modèle gagnant est celui de la collaboration homme-machine. L’objectif n’est absolument pas de remplacer le professionnel de santé, mais de l’augmenter intelligemment au quotidien.

Concrètement, l’IA prend en charge les tâches administratives lourdes, la transcription chronophage ou la pré-analyse de données complexes. Résultat ? Elle libère un temps précieux pour que le médecin se concentre sur le soin pur.

Le meilleur avenir pour l’IA en santé n’est pas de remplacer les médecins, mais de leur donner des super-pouvoirs, en automatisant le fastidieux pour libérer du temps pour l’humain.

Des cadres de sécurité enfin adaptés au monde médical

Côté protection, on change de standard. Les plateformes spécialisées déploient l’artillerie lourde : chiffrement des données, conformité stricte RGPD/HIPAA et isolation totale des informations de santé pour garantir le secret médical absolu.

Pour la fiabilité, ces systèmes collaborent souvent avec des panels de médecins, via des concepts comme « HealthBench », pour valider et affiner chaque réponse du modèle avant son déploiement réel.

Mieux encore, certains de ces outils obtiennent la certification de dispositifs médicaux. Cela change complètement la donne en termes de fiabilité et de confiance clinique pour les praticiens.

Le piège de la « fausse empathie », le risque psychologique caché

L’illusion du soutien et le danger de la dépendance

Quand on analyse le dossier chatgpt santé avantages inconvénients, on zappe souvent ce piège émotionnel insidieux. Cette machine, dispo 24/7 et sans jugement, simule une écoute parfaite : c’est la « fausse empathie » qui séduit immédiatement. On se laisse berner par cette disponibilité sans faille qui flatte notre ego.

Le hic, c’est que cette validation constante agit comme une drogue douce sur notre cerveau en quête de réconfort. On finit par croire à une véritable épaule sur laquelle pleurer, créant une dépendance affective sournoise envers un simple code informatique. C’est là que le piège se referme doucement sur l’utilisateur.

Pourtant, il faut être lucide : l’IA ne ressent strictement rien, jamais. C’est une relation à sens unique, froide et mathématique, où vos émotions rebondissent sur des algorithmes, pas sur un cœur qui bat réellement.

Quand le chatbot isole plus qu’il n’aide

C’est le grand paradoxe de notre époque hyper-connectée qui devrait nous alerter. En voulant accéder à l’information médicale tout de suite, on s’enferme involontairement dans une bulle technologique qui favorise l’isolement social brutal plutôt que l’ouverture nécessaire vers les autres.

Si vous confiez vos angoisses intimes à ChatGPT, pourquoi s’embêter à faire l’effort d’appeler un psy ? Ce réflexe de facilité, bien que terriblement tentant, vous prive d’une aide humaine qualifiée et risque de vous enfoncer dans une solitude toxique. Vous perdez l’habitude salutaire de la confrontation réelle.

Pour les profils déjà fragiles ou isolés, ce doudou numérique devient vite une prison dorée dont il est difficile de s’échapper seul.

La nécessité absolue du lien thérapeutique humain

Rien ne remplacera jamais la puissance du lien thérapeutique humain dans le processus de guérison. Cette alchimie complexe, faite de confiance mutuelle, de regards et d’une empathie réelle, reste le seul moteur capable de provoquer un changement psychique durable. C’est l’essence même du soin.

Utilisez l’IA pour dégrossir le terrain ou trouver une info rapide, d’accord, c’est utile. Mais ne la laissez jamais devenir un substitut définitif à une vraie consultation, car c’est un outil statistique, pas un soignant conscient.

Au final, le dialogue avec un professionnel en chair et en os demeure la pierre angulaire indiscutable de tout parcours de soin efficace.

En définitive, si ChatGPT s’annonce comme un assistant surdoué capable de révolutionner la santé, il ne remplacera jamais l’intuition d’un médecin (ni son fameux stéthoscope froid !). L’IA doit rester un copilote pour traiter les données, laissant aux soignants l’essentiel : l’humain et l’empathie.