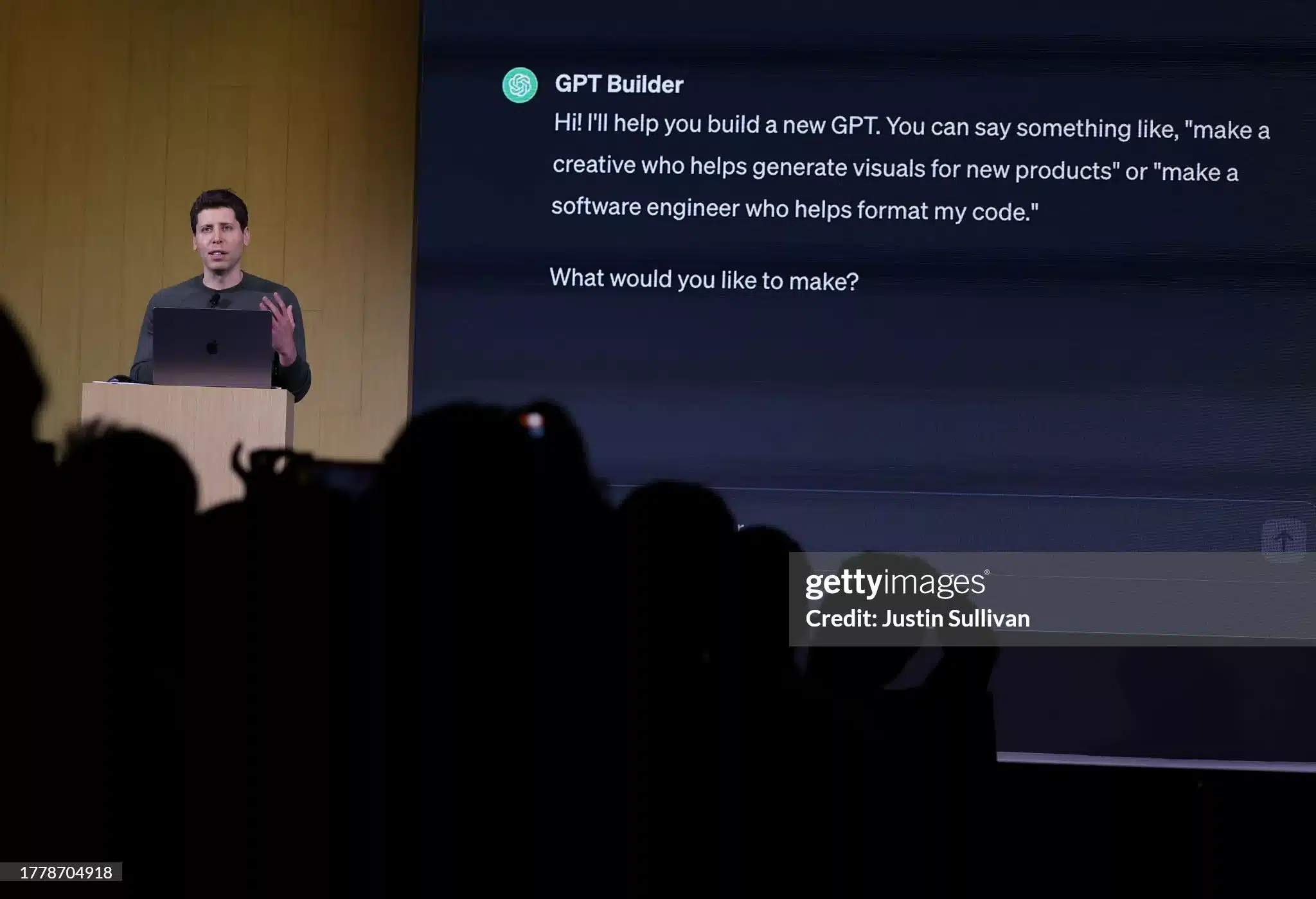

OpenAI DevDay : Une Plongée dans le Monde de l'Intelligence Artificielle

San Francisco, le 6 novembre 2023 – L’OpenAI DevDay du 6 novembre 2023 a été l’occasion d’explorer de passionnantes innovations et de profiter d’offres spéciales, révolutionnant ainsi l’univers de l’intelligence artificielle. Au cœur de cet événement, l’annonce de nouveaux modèles et des réductions de coûts sur la plateforme OpenAI a marqué un tournant dans le domaine. Voici un aperçu complet des moments forts de cette journée mémorable

GPT-4 Turbo avec 128K de contexte : Une Avancée Majeure dans le Traitement du Langage Naturel

L’un des moments phares de l’événement a été la présentation de GPT-4 Turbo, la dernière itération de la célèbre série GPT. Ce modèle se distingue par sa capacité à traiter un volume impressionnant de texte, équivalent à plus de 300 pages en une seule requête. De plus, son utilisation a été rendue plus économique, avec des coûts réduits de trois fois pour les entrées et de deux fois pour les sorties par rapport à son prédécesseur. Les développeurs payants ont d’ores et déjà accès à ce modèle, tandis que la version stable sera bientôt accessible à tous.

Révolution dans les Conversations avec l'IA

L’OpenAI DevDay a marqué un tournant dans les interactions avec l’intelligence artificielle. Les nouvelles améliorations permettent de simplifier les conversations, en regroupant plusieurs instructions dans un même échange. Cette évolution facilite grandement l’interaction avec l’IA.

Des Instructions Plus Précises et un Nouveau Mode JSON

L’IA GPT-4 Turbo excelle dans la compréhension précise des instructions, facilitant ainsi la génération de contenus spécifiques. Une nouveauté majeure est l’introduction du mode JSON, garantissant que l’IA génère des objets JSON valides. Cette fonctionnalité s’avère particulièrement utile pour les développeurs utilisant l’API de complétion de chat en dehors des conversations.

Des Résultats Cohérents et Les Probabilités de Réponses

L’introduction du paramètre de grain permet d’obtenir des résultats cohérents, favorisant des complétions fiables dans la plupart des cas. Cette fonctionnalité est précieuse pour le débogage, les tests unitaires complets et le contrôle du comportement de l’IA. OpenAI prévoit également de fournir des informations sur la probabilité des réponses générées par GPT-4 Turbo et GPT-3.5 Turbo dans les prochaines semaines. Cette fonctionnalité sera particulièrement utile pour des applications telles que l’autocomplétion dans les recherches en ligne.

Mise à Jour de GPT-3.5 Turbo

En plus de GPT-4 Turbo, une nouvelle version de GPT-3.5 Turbo est désormais disponible, avec une fenêtre de contexte de 16 000 tokens par défaut. Cette mise à jour apporte d’importantes améliorations en termes de précision des réponses, de mode JSON et d’appels de fonctions parallèles. Les développeurs peuvent accéder à ce nouveau modèle en utilisant gpt-3.5-turbo-1106 dans l’API.

L'API des Assistants, l'Avènement d'Applications Intelligemment Assistées

OpenAI a dévoilé l’API des Assistants, une innovation révolutionnaire permettant aux développeurs de créer des expériences assistées par des IA spécialisées. Ces assistants sont équipés d’instructions spécifiques et de connaissances supplémentaires, leur permettant d’utiliser des modèles et des outils pour effectuer des tâches précises. Cette API ouvre de nouvelles perspectives pour le développement d’applications IA de haute qualité.

De Nouvelles Possibilités avec l'IA

GPT-4 Turbo avec Vision

GPT-4 Turbo peut désormais traiter des images dans l’API de complétion de chat. Cette fonctionnalité ouvre la porte à un éventail de cas d’utilisation passionnants, notamment la génération de légendes pour les images, l’analyse d’images du monde réel et la lecture de documents contenant des images. Des applications telles que BeMyEyes utilisent cette technologie pour assister les personnes aveugles ou malvoyantes dans leurs tâches quotidiennes. Les développeurs peuvent accéder à cette fonctionnalité en utilisant gpt-4-vision-preview dans l’API.

DALL·E 3

Les développeurs peuvent désormais intégrer DALL·E 3 directement dans leurs applications en spécifiant dall-e-3 comme modèle. Des entreprises de renom telles que Snap, Coca-Cola et Shutterstock l’utilisent pour générer des images et des designs de manière automatisée. L’API intègre également des mécanismes de modération pour prévenir les abus.

Text-to-speech (TTS)

Les développeurs peuvent désormais générer un discours de haute qualité à partir de texte grâce à l’API Text-to-speech. Cette API propose six voix préréglées et deux variantes de modèle : tts-1 et tts-1-hd. Les tarifs commencent à 0,015 $ par tranche de 1 000 caractères d’entrée.

Personnalisation de l'IA

La personnalisation de l’IA est désormais au coeur des ambitions d’OpenAI, en effet, l’entreprise travaille sur un programme expérimental de personnalisation de GPT-4. Bien que la personnalisation nécessite des ajustements pour obtenir des résultats significatifs par rapport au modèle de base, les développeurs utilisant déjà la personnalisation avec GPT-3.5 auront bientôt la possibilité de migrer vers GPT-4. OpenAI lance également un programme de Modèles Personnalisés nommés « GPTs » pour les organisations qui nécessitent une personnalisation plus poussée.

Réductions de Prix et Augmentation des Possibilités

OpenAI a abaissé les coûts sur plusieurs aspects de sa plateforme, offrant ainsi aux développeurs une plus grande marge de manœuvre pour créer des applications. De plus, OpenAI a doublé les limites de tokens par minute pour tous les clients payants de GPT-4, améliorant ainsi leur capacité à gérer des applications à grande échelle.

Shield de Droit d'Auteur

OpenAI se soucie de la protection de ses clients. En plus des mécanismes de protection des droits d’auteur en place, OpenAI a introduit le Copyright Shield, un service qui défend les clients et prend en charge les coûts liés aux réclamations légales pour violation de droits d’auteur.

Whisper v3 et Consistency Decoder

OpenAI a publié Whisper large-v3, la prochaine version de son modèle de reconnaissance automatique de la parole en open source, offrant des performances améliorées dans plusieurs langues. De plus, OpenAI a rendu open source le Consistency Decoder, un décodeur qui améliore considérablement la qualité des images compatibles avec le Stable Diffusion VAE, avec des améliorations significatives pour les textes, les visages et les lignes droites.

Notre conclusion sur L'OpenAI DevDay

L »entreprise continue d’innover et d’améliorer ses produits pour offrir des capacités d’intelligence artificielle de pointe aux développeurs du monde entier. Ces annonces marquent une étape importante dans le domaine de l’IA, ouvrant la voie à des applications encore plus puissantes et polyvalentes. Restez à l’écoute pour plus de mises à jour passionnantes de la part d’OpenAI.

0 commentaire